新加坡前總理李顯龍,再一次展現了他對未來的預知能力。

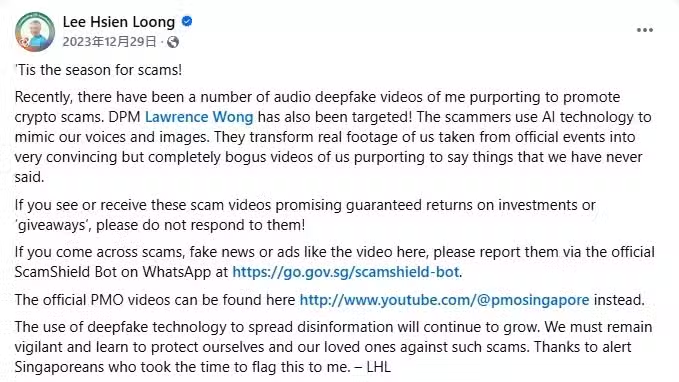

早在2023年的12月29日,時任新加坡總理的李顯龍就在自己的facebook上發布了一封警告信,讓公眾警惕deepfake對信息安全造成的威脅。

他在貼文中寫道:「使用Deepfake(深偽)技術傳播虛假信息的情況將繼續增長。我們必須保持警惕,學會保護自己和親人免受此類騙局的侵害,」

而就在今年八月,「韓國 換臉」這個詞條衝上中國社交媒體熱搜榜一!

韓國年輕人們正利用深偽技術,將身邊的女性親人或朋友的臉合成色情相片與視頻,並通過通信軟體進行廣泛傳播。

當時,這波深偽大案不僅在大學生和中學生中引起了恐慌,甚至還擴展到了軍隊、教師和護士等特定職業的女性。這些偽造的圖頻中,甚至使用了軍隊內部網絡才能使用到的證件照,可能韓國軍方人員都參與其中。

其中一個換臉聊天室竟吸引了22萬人,一時之間所有韓國女性人人自危,全世界女性義憤填膺。因為魔爪不僅來自不懷好意的陌生人,更有可能來自和自己朝夕相處的親人、朋友和同事。

本以為,這可能只是在韓國存在,沒想到,這幾天,這股風竟然吹到了新加坡......

深偽案件波及新加坡中學

就在全世界都關注韓國如何善後,如何針對這喪心病狂的年輕群體性犯罪進行處罰和打擊之際,萬萬沒想到的是!在新加坡這個作為整個亞洲女性地位最高的國家之一,又有著對色情犯罪嚴苛的打擊法規的國家,卻竟然同樣發現了「換臉」罪行!

本周一(11月11日),一位新加坡體育學校的學生家長爆料稱,自己女兒的照片竟然被同校的男同學利用深為技術移花接木,製作成了裸照。

新加坡體育學校,圖片來自網絡

新加坡體育學校是一所寄宿學校,每年只招收大概100多名學生,而就讀的學生年齡介於13-18歲之間。

這些男生們分工明確,一組製造照片,而另一組則通過群組聊天的方式進行傳播!而受害者除了新加坡體育學校的女學生外,甚至連教師也成為了目標!

示意圖,圖源:CNA

新加坡體育學校深偽事件其實從今年6月份就已經開始,疑似受到了韓國深偽事件的影響,校方早就和警方合作偵查此事了;只是事件發酵到了11月才被校方發現並立刻採取了相關的應對措施。

新加坡不愧是整個亞洲打擊性犯罪最嚴苛的國家,校方直接動用了令人聞風喪膽的鞭刑!

圖片來自網絡

是的!新加坡的學校是有權對頑劣的孩子進行鞭刑的!但這種鞭刑和監獄的鞭刑有很大區別:

1、鞭子使用的是藤製,比監獄司法用刑的鞭子要輕細很多 2、司法鞭刑最多24下,而學校的鞭刑一般介於1-3下,主要是小懲大戒

另外,針對學生的鞭刑還有三種不同的公開形式:

a、私下鞭打:主要是在校務處或者校長辦公室進行鞭打,在場除了校長或副校長以外,還會有一名老師作為見證人,有時候學生的家長也可能會被要求到場見證。

b、教室鞭打:即當著全班同學的面進行鞭打。

c、公開鞭打:這是最屈辱的方式,地點一般是禮堂,讓被體罰的學生上台,在全校師生面前公開對他進行鞭刑。

根據報道顯示,新加坡體育學校深偽事件中犯事的部分孩子接受的是私下鞭打,即在校務處或者校長辦公室進行的秘密鞭打。

示意圖

但是,還是有人認為,新加坡體育學校實行的鞭刑還不夠解氣,應該公開鞭刑讓所有學生都引以為戒。

AI深偽犯罪讓人防不勝防

令人感到擔憂的是,看似這只是新加坡某個學校發生的小範圍事件,但實際上卻帶來了更多更難以的辨別的犯罪。

讓我們來回顧一下這波深偽色情案的風波始末,各位椰友或許便能明白,深偽技術已經成為我們未來生活中虎視眈眈的惡魔。

隨著AI技術的崛起,深偽技術在詐騙方面的使用也變得越來越頻繁,越來越真偽難辨。

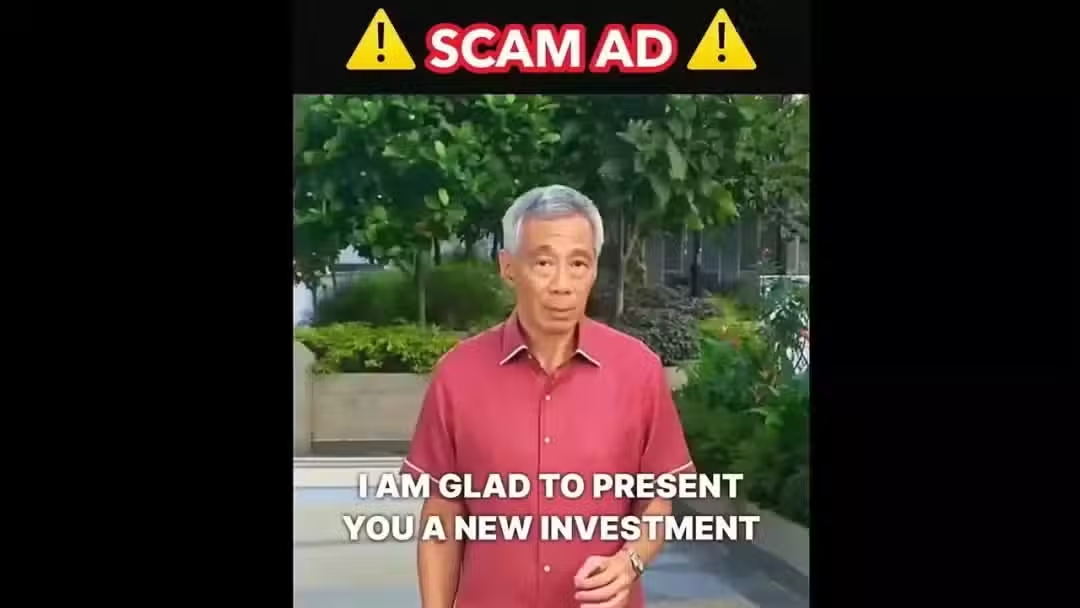

比如李顯龍和黃循財,就曾多次被詐騙分子盯上,用他們的臉行詐騙之實。

某則投資詐騙廣告就利用了李顯龍

同樣的深偽技術還被使用在色情照片和視頻上,如今的AI已經可以通過讀取人臉照片的細節,生成獨特的數字人模型,這樣就可以以模型人物為原型,製作出不同動作場景的色情詐騙。

最受深偽技術之害的國際明星當屬霉霉,之前由她人臉生成的一組色情照片,在網絡廣為流傳。

照片是她和一隊身穿艷紅色球衣的球員們,在休息室發生的種種,

圖片來自網絡

照片已經過模糊處理,但可以看到人臉部分的細節度非常逼真,且AI生成的圖片幾乎不受想像力的限制,任何場景、任何動作、任何角度都可以生成。

這無疑給了那些具有色情幻想人士創造了一個肆無忌憚的樂土。

而深偽技術不僅可以生成照片,如今也可以通過換臉的方式生成視頻。

通過讀取目標人臉的特徵,AI可以通過換臉的方式,將一個無辜女孩的臉,換到某位色情女明星的身體上,便能構成一段不堪入目的視頻。

圖片來自網絡

或許你認為這件事情離你很遙遠?

不!遠不要低估青少年對性的幻想與衝動,也不要低估了人性在慾望的驅使之下,會做出的惡魔行徑。

在韓國發生這件事,敲響了全世界警鐘 不知道你是否聽說過韓國N號房事件?

這是發生在2018年至2020年之間的韓國性剝削案件。作案者通過加密即時通訊軟體Telegram建立多個聊天室,傳播對女性進行性威脅得來的資料、相片、影片甚至進行直播。

N號房分成了不同的專題滿足不同癖好觀看者

這些受害者被要求在身體上刻字、食糞飲尿、塞入蟲子、侵犯年幼的親屬,甚至進行同步直播。

受害者被威脅如果不遵從,就會將她們的不雅照公之於眾,這讓這些弱勢女性們不得不一而再再而三遭受威脅。

據稱當時進行調查N號房事件的人因為長期接觸這些視頻以搜尋證據,心理上都出現了不同程度的損傷。

N號房事件在當年沸沸揚揚,國際女性一致申討韓國物化女性,對女性不尊重的醜惡文化。

沒想到時隔4年,風波再起,這次韓國爆發的深偽換臉事件,被稱為N號房間2.0,其惡劣程度不亞於當年的1.0。

因擔心在韓國求助無門,來微博曝光韓國深偽換臉的韓國女性 N號房1.0中傳播的照片和視頻都真實存在,犯罪者首先要通過深度接觸受害者,獲得不雅照片或視頻,才能進而威脅到女性接受性剝削,犯罪成本相對較高。

但2.0卻完全不同,只要擁有受害者的一組清晰照片,便可以無限制地創造出無數不雅照片或視頻,受害女性在毫不知情的情況下便已經被侵害!

新加坡必須保持警惕 你認為這件事情仍然離你很遠麼?那看看這一組數據吧!

2023年新加坡詐騙案件數量創下歷史新高,報告案件超過了46000起,詐騙受害者一共損失6.518億新幣!

Deepfake性勒索雖然是一種新現象,暫時的比例並不高,但已有逐步抬頭的趨勢。

如果你覺得這類Deepfake的性勒索,僅存在於有過「某種不正當關係」的男女之間,那麼就大錯特錯。

只要你被有心之人拿走一段清晰正面視頻,甚至多角度的個人照片,都有可能被深偽技術篡改成色情照片和視頻,從而成為他人勒索你的要挾。

而受害者也不止是女性。

之前,新加坡一名男子在約會應用上和一名女子聯繫一段時間後,對方要求他通過Telegram進行視頻通話,之後該女子通過這段視頻通話錄製的內容,製作了不雅照片。

照片上,這名新加坡男子赤裸著靠在另一個男子的裸體上。

該女子威脅新加坡男子,必須給自己的銀行帳戶轉1000新幣,否則就會在各社交媒體上將這個照片分發給他的朋友們。

而新加坡的新一波受害者,便是政府要員,他們因為經常在公開場合發表演講,留下相當多的視頻資料,因此是深偽勒索的最易受風險人群。

今年4月期間,新加坡議員集體遭受侵害,他們陸續收到了一份郵件,裡面是將自己的形象經過深偽處理後的不雅視頻,並附上了一封勒索信。

收到信件的人包括楊厝港國會議員葉漢榮、外交部長維文 (Vivian Balakrishnan)、裕廊區議員陳吳明 (Tan Wu Ming) 和荷蘭-武吉知馬區議員愛德華·謝 (Edward Chia)等等。